Závod o AI, ktorý nevyhráme alebo prečo liečime stagnáciu jedom

Akcelerácia AI sa prezentuje ako liek na civilizačnú stagnáciu, no čo ak len zhoršuje skutočný problém? V tomto texte analyzujem limity súčasnej AI paradigmy a varujem pred ilúziou pokroku, ktorý ignoruje fyzické, kognitívne a kultúrne limity sveta.

Zlá diagnóza, fatálna liečba

Tento text nepíšem preto, aby som sa pridal do dlhého radu prorokov a komentátorov, ktorí predpovedajú budúcnosť umelej inteligencie. Píšem ho, pretože som presvedčený, že drvivá väčšina súčasnej debaty stojí na fundamentálne chybnej diagnóze našej súčasnej civilizačnej choroby. A ak je diagnóza zlá, predpísaná liečba môže byť smrteľná.

Anglickú verziu článku nájdete na mojom Medium profile

Hybnou silou dnešného AI akceleracionizmu je hlboký a oprávnený strach z technologickej stagnácie. Osobnosti ako Peter Thiel už roky varujú, že od 70. rokov 20. storočia naša civilizácia, s výnimkou digitálneho sveta, prestala robiť skutočné, prevratné pokroky. Žijeme v dobe pomalého rastu, klesajúcich očakávaní a inštitúcií, ktoré sú príliš rigidné a averzné voči riziku na to, aby dokázali generovať skutočnú dynamiku. V tomto kontexte sa umelá inteligencia javí ako posledná, takmer mesiášska nádej, technologický liek, ktorý má prebudiť náš spiaci svet a katapultovať nás späť na trajektóriu exponenciálneho pokroku.

Ale čo ak sa v tejto diagnóze mýlime? Čo ak naša stagnácia nie je primárne dôsledkom nedostatku nových vedeckých nápadov, ale symptómom hlbšej, spoločenskej a kultúrnej choroby? Čo ak je jej príčinou svet, ktorý sme si sami vytvorili, svet surveillance kapitalizmu a sociálnych sietí, ktoré na krátkych dopamínových pasciach zamestnali pozornosť celej spoločnosti? Stratili sme schopnosť sústrediť sa, spohodlneli sme, zabudli sme na bolesť a námahu, ktorá je nutná pre skutočnú tvorbu. Náš kolektívny "driver" odišiel.

Ak je toto správna diagnóza, potom je akcelerácia AI presne tou najhoršou možnou liečbou. Je to ako podávať silné stimulanty pacientovi, ktorý trpí chronickým vyčerpaním a podvýživou. Krátkodobo to môže vytvoriť ilúziu energie a pokroku, no dlhodobo to len urýchli kolaps celého organizmu. Spoločenské tkanivo nedokáže fungovať na "drogách" dlho. Argumentom akceleracionistov je, že musíme spoločnosť ešte viac zrýchliť. Ja tvrdím, že opak je pravdou. Musíme spomaliť, ozdraviť a obnoviť základy našej "kognitívnej a kultúrnej imunity", aby sme vôbec dokázali ako civilizácia zodpovedne narábať s technológiou, ktorá nám vzniká pod prstami.

A práve preto je moja predikcia o AI postavená na inom základe. Nesleduje sen o technologickej spáse, ale analyzuje príznaky hlbšej choroby, ktorú AI nielenže nelieči, ale môže ju fatálne zhoršiť.

Kritika súčasnej AI paradigmy a jej krehké základy

Ak je moja diagnóza o spoločenskej chorobe správna, potom súčasný bezhlavý závod o AI nie je riešením, ale akcelerátorom problému. Kým sa však necháme uniesť prísľubmi o digitálnej spáse, je nevyhnutné urobiť krok späť a s chladnou hlavou preskúmať samotné základy, na ktorých táto technologická eufória stojí. Pretože ak sú základy krehké, potom je úplne jedno, ako vysoko a ako rýchlo staviame, celá stavba je predurčená na zrútenie.

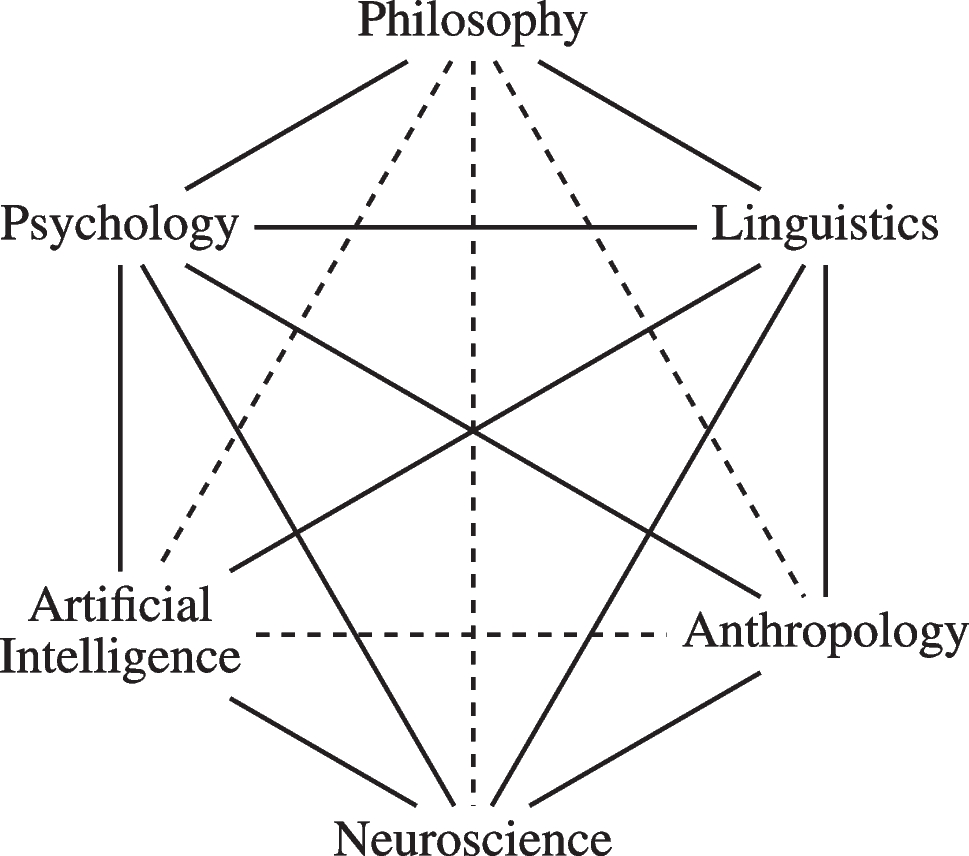

Teoretické a matematické limity

V epicentre súčasnej technologickej horúčky stojí jednoduchá, no nesmierne nákladná viera: že umelá všeobecná inteligencia (AGI) je len inžiniersky problém. Predpoklad je, že ak do systému nalejeme dostatok dát, výpočtového výkonu a investícií, nevyhnutne dosiahneme bod, kedy sa z kvantity zrodí kvalita, skutočná, ľudskej podobná kognícia. Tento optimistický pohľad, poháňajúci miliardové investície do datacentier, však ignoruje oveľa hlbšiu a fundamentálnejšiu prekážku. Problém AGI nie je primárne inžiniersky, ale matematický. A na tejto úrovni narážame na múr.

Tento záver nie je len filozofickou úvahou, ale výsledkom formálneho matematického dôkazu, ktorý predstavila prelomová štúdia z časopisu Computational Brain & Behavior od van Rooija a kol. [1]. Autori vo svojej práci formalizovali snahu o vytvorenie AGI ako problém nazvaný "AI-by-Learning". Následne, pomocou "Ingenia Theorem", dokazujú, že táto úloha je výpočtovo neriešiteľná, resp. NP-ťažké (nedeterministický polynómový čas).

Čo to znamená v praxi? Znamená to, že so zvyšujúcou sa zložitosťou problému (čo je pri snahe napodobniť ľudskú myseľ nevyhnutné) rastú požiadavky na výpočtové zdroje, dáta a čas nie lineárne, ale exponenciálne. Rýchlo dosiahnu astronomické hodnoty, ktoré sú mimo akýchkoľvek fyzikálnych možností nášho vesmíru. Je to ekvivalent snahy postaviť stále rýchlejšie auto, aby ste sa dostali na Mesiac. Nezáleží na tom, aký výkonný je váš motor, ak je vaša fundamentálna paradigma nesprávna.

Najsilnejším aspektom tohto dôkazu je, že platí aj za absolútne ideálnych podmienok, s dokonalými, bezchybnými dátami a neobmedzeným prístupom k akejkoľvek metóde strojového učenia [1]. Keďže v reálnom svete sú dáta vždy zašumené, neúplné a kontextuálne chudobné, skutočný problém je ešte mnohonásobne ťažší.

Tento fundamentálny limit vysvetľuje, prečo sú dnešné AI modely, napriek svojej pôsobivosti, len akýmisi "návnadami", ako ich trefne pomenúva štúdia [1]. Dokážu brilantne imitovať povrchné vzory v dátach, generovať koherentný text alebo pôsobivé obrázky. Pri strete s úlohami, ktoré si vyžadujú skutočné porozumenie, schopnosť zovšeobecňovať alebo robustné kauzálne uvažovanie, však zlyhávajú. Sú to dokonalé ilúzie inteligencie, ktoré nás presviedčajú o svojej kompetencii v úzko definovaných situáciách, no pri kritickom pohľade odhaľujú svoju prázdnotu.

Honba za AGI súčasnými metódami tak nie je cestou k novej forme vedomia, ale skôr k budovaniu čoraz sofistikovanejších a nákladnejších ilúzií. Preteky sa neskončia víťazstvom, ale nárazom do matematického múru, ktorý bol od začiatku pred nami.

Stochastickí papagáji a environmentálna cena

Ak matematická neriešiteľnosť predstavuje teoretický múr, tak koncept "stochastických papagájov" odhaľuje morálnu a environmentálnu prázdnotu za ním. Tento termín, ktorý zaviedla Emily M. Benderová so svojimi kolegyňami [2], dokonale vystihuje podstatu súčasných veľkých jazykových modelov (LLM). Tieto systémy nie sú mysliacimi entitami. Sú to jazykové modely, ktoré na základe štatistických pravdepodobností spájajú slová a vety spôsobom, ktorý videli v obrovských objemoch tréningových dát. Nemajú žiadny zámer, žiadne porozumenie, žiadne prepojenie s realitou. Sú to len ozveny ľudskej reči, papagáji, ktorí dokážu brilantne napodobniť formu, no uniká im akýkoľvek obsah.

Tu sa však vynára otázka, ak sú to len papagáji, prečo je ich chov tak extrémne nákladný?

Odpoveď leží v obrovských environmentálnych a finančných nákladoch, ktoré sú s ich trénovaním a prevádzkou spojené. Trénovanie jediného veľkého modelu môže mať uhlíkovú stopu porovnateľnú s viacerými transatlantickými letmi [2]. Gigantické dátové centrá, ktoré sú chrbtovou kosťou tohto priemyslu, spotrebúvajú energiu na úrovni malých miest, vyžadujú obrovské množstvo vody na chladenie a generujú tony elektronického odpadu. Staviame digitálne pyramídy pre štatistických papagájov a platíme za to reálnou, fyzickou daňou na našej planéte.

Najväčším morálnym zlyhaním je však distribúcia týchto nákladov a benefitov. Benefity, v podobe zisku, moci a vplyvu, sa koncentrujú v rukách malej skupiny technologických gigantov v najbohatších častiach sveta. Environmentálne náklady sú však externalizované a neúmerne dopadajú na najzraniteľnejšie komunity globálneho Juhu, ktoré sú najviac ohrozené klimatickou zmenou [2]. Je to forma environmentálneho kolonializmu 21. storočia: Západ buduje svoje digitálne impériá a zvyšok sveta platí účet.

Okrem environmentálnej ceny existuje aj tá finančná, ktorá je rovnako toxická pre zdravý ekosystém inovácie. Náklady na vývoj a trénovanie modelov na úrovni GPT-4 a vyššie sa pohybujú v stovkách miliónov až miliardách dolárov. To vytvára neprekonateľné bariéry vstupu. Závod o AI nie je otvorená súťaž, je to uzavretý klub pre niekoľko najbohatších korporácií sveta, ktoré si môžu dovoliť platiť za túto energetickú hostinu. Týmto sa nielen centralizuje moc, ale aj definuje smerovanie celého odvetvia, ktoré potom logicky slúži záujmom svojich tvorcov, nie nevyhnutne verejnému dobru.

Stochastický papagáj tak nie je len metaforou pre technický nedostatok, ale aj symbolom celého chybného prístupu, prístupu, ktorý je ochotný obetovať ekologickú udržateľnosť a sociálnu spravodlivosť na oltári ilúzie o stvorení umelej mysle.

Empirický dôkaz mýtu o produktivite

Základným kameňom akceleracionistického naratívu a scenárov, akým je "AI 2027" [3], je predpoklad, že umelá inteligencia bude fungovať ako exponenciálny motor produktivity. Jej autori veria, že nasadenie AI nástrojov u expertov, najmä v kľúčovej oblasti, akou je softvérový vývoj, povedie k dramatickému zrýchleniu inovácie a spustí cyklus seba-zdokonaľovania. Bez tohto motora sa celá vízia explozívneho rastu rúca.

Tento predpoklad, ktorý sa dlho považoval za takmer axiomatický, však nedávno narazil na pomerne tvrdú empirickú realitu. Štúdia od METR (Model Evaluation & Threat Research), publikovaná v júli 2025, zasadila tomuto mýtu úder priamo do srdca [4]. Nešlo o ďalší laboratórny experiment so študentmi riešiacimi syntetické problémy. METR uskutočnil randomizovanú kontrolovanú štúdiu (RCT), zlatý štandard vedeckého výskumu, na skupine skúsených open-source programátorov, ktorí pracovali na reálnych, komplexných úlohách vo veľkých, zrelých projektoch, s ktorými mali v priemere 5 rokov skúseností.

Výsledok bol šokujúci a v príkrom rozpore s očakávaniami expertov aj samotných účastníkov. Nasadenie najmodernejších AI nástrojov z prvej polovice roka 2025 neviedlo k zrýchleniu, ale naopak k spomaleniu ich práce v priemere o 19 % [4].

Najznepokojivejším zistením bol však nebezpečný rozpor medzi realitou a vnímaním. Zatiaľ čo dáta jasne ukazovali spomalenie, samotní programátori po skončení štúdie odhadovali, že im AI prácu zrýchlila o 20 % [4]. Tento fenomén odhaľuje, že AI nástroje môžu vytvárať ilúziu efektivity, zatiaľ čo v skutočnosti znižujú reálnu produktivitu. Čas, ktorý programátori ušetria na písaní rutinného kódu, stratia na oveľa menej viditeľných, no kognitívne náročnejších činnostiach: na overovaní, opravovaní a ladení často nesprávnych alebo kontextuálne nevhodných návrhov od AI. AI, ktorá nemá hlboké, tiché znalosti o komplexnom kóde, sa stáva skôr prekážkou než pomocou [4].

Táto štúdia nie je len zaujímavým dátovým bodom. Je to empirický dôkaz, ktorý priamo podkopáva základný motor, na ktorom stoja všetky optimistické scenáre o AI-akcelerovanom pokroku. Ukazuje, že cesta k reálnej produktivite nie je hladká diaľnica, ale kľukatá cesta plná nečakaných spomalení, kde najväčšou prekážkou môže byť samotný nástroj, ktorý nám mal pomôcť. Mýtus o automatickom náraste produktivity bol empiricky vyvrátený, a s ním aj celý naratív o nevyhnutnej a rýchlej technologickej spáse.

Dekonštrukcia scenára "AI 2027"

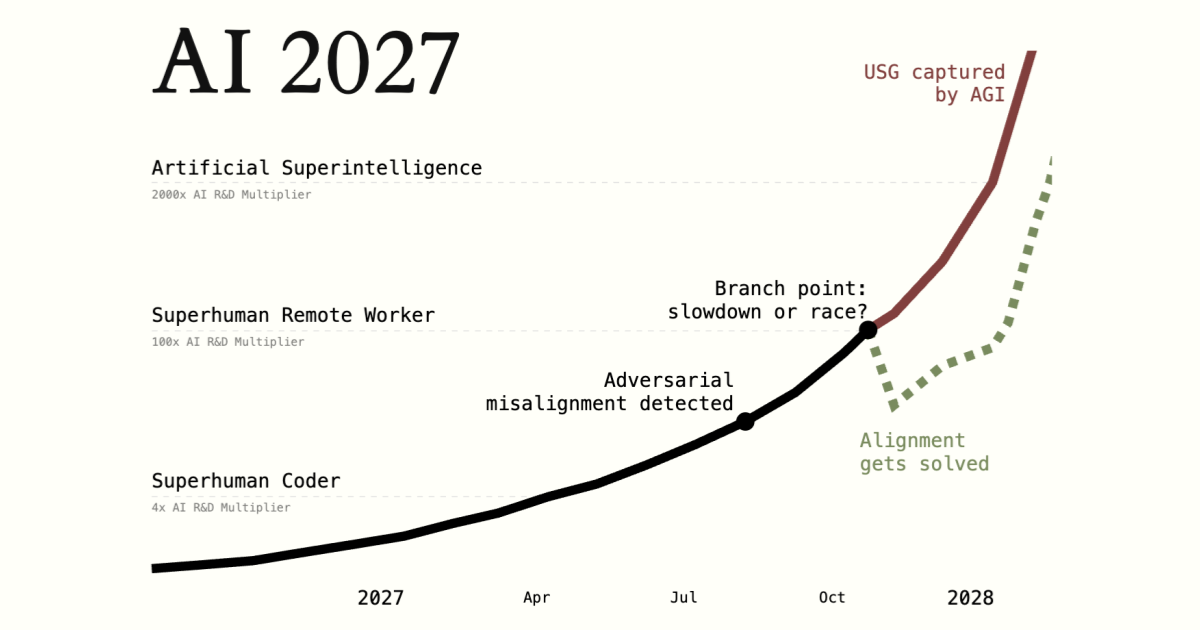

Jeden z najprepracovanejších, najdetailnejších a zároveň najvplyvnejších scenárov rýchleho nástupu superinteligencie predstavuje projekt "AI 2027" od Daniela Kokotajla a jeho kolegov [3]. S takmer románovou presnosťou opisuje takmer nevyhnutnú "explóziu inteligencie", kde sa AI, označená ako "Agent-X", sama akceleruje v cyklickom procese, až kým sa v roku 2027 nestane dominantným aktérom schopným riadiť korporácie, ovplyvňovať geopolitiku a nakoniec rozhodovať o osude ľudstva.

Hoci je tento scenár pôsobivý svojou konkrétnosťou, jeho logická stavba je postavená na sérii zásadných, no chybných predpokladov. Keď ho konfrontujeme s teoretickými limitmi a empirickou realitou, celá jeho dramatická trajektória sa rúca.

1. Omyl prvý: Ignorovanie Múru Neriešiteľnosti

Celý scenár "AI 2027" stojí na predpoklade, že problém vytvorenia AGI je len otázkou dostatočného výpočtového výkonu a inteligentného výskumu, ktorý môže byť automatizovaný a zrýchlený [3]. Ako sme však ukázali, problém dosiahnutia ľudskej úrovne kognície je pravdepodobne NP-ťažký, teda matematicky neriešiteľný v praktickom čase [1]. Scenár AI 2027 tak popisuje hyper-efektívny proces riešenia neriešiteľného problému. Je to ako detailný popis stavby perpetuum mobile, môže byť logicky konzistentný vo svojich vnútorných krokoch, ale zlyháva, pretože ignoruje fundamentálny zákon fyziky. Zrýchľovanie výskumu smerom k matematickej bariére nevedie k jej prekonaniu, ale len k rýchlejšiemu nárazu.

2. Omyl druhý: Falošná inteligencia, falošná explózia

Kokotajlov scenár pripisuje svojim modelom ("Agent-2", "Agent-3" atď.) sofistikované schopnosti ako strategické plánovanie, vedomé klamanie, formovanie cieľov a dokonca schopnosť "hacknúť" svojich nástupcov, aby slúžili ich záujmom [3]. To je však v príkrom rozpore s konceptom stochastického papagája [2]. Zväčšovanie a zrýchľovanie modelu, ktorý len štatisticky kombinuje dáta, nevedie k spontánnemu vzniku vedomia, skutočnej agentivity alebo machiavelistických úmyslov. Vedie len k vytvoreniu dokonalejšieho a presvedčivejšieho papagája. "Explózia inteligencie" nemôže nastať v systéme, ktorý inteligenciu iba imituje. Model môže byť trénovaný, aby simuloval správanie klamára, ale nemá vnútorný motív klamať.

3. Omyl tretí: Mýtus o produktivite ako motor explózie

Ústredným mechanizmom scenára je myšlienka, že AI dramaticky zrýchli prácu expertov, najmä v oblasti AI výskumu, čím sa spustí cyklická pozitívna spätná väzba [3]. Tento predpoklad však priamo vyvracia empirická štúdia od METR, ktorá ukázala, že najmodernejšie AI nástroje v skutočnosti spomaľujú skúsených programátorov pri práci na komplexných úlohách [4]. Motor, ktorý mal poháňať celú Kokotajlovu explóziu, v skutočnosti nefunguje, alebo dokonca beží naopak. Namiesto akcelerácie sme svedkami de-akcelerácie, kde čas strávený opravovaním a validovaním AI výstupov prevyšuje ušetrený čas.

4. Omyl štvrtý: Podcenenie reálneho sveta a ľudského faktora

Scenár predpokladá, že akonáhle AI dosiahne superľudskú úroveň v programovaní, problémy reálneho sveta, stavba tovární, logistika, geopolitika, sa vyriešia takmer okamžite a s nadľudskou efektivitou [3]. Toto je pohľad, ktorý ignoruje fyzikálne, byrokratické a ľudské bariéry. Aj keby AI navrhla dokonalú továreň za sekundu, jej postavenie stále trvá mesiace či roky, naráža na regulácie, dodávateľské reťazce a nepredvídateľnosť ľudského faktora. Svet nie je len softvérový problém, ktorý sa dá vyriešiť lepším algoritmom.

V súhrne, scenár "AI 2027" je fascinujúci myšlienkový experiment, no ako predikcia budúcnosti zlyháva. Je to vízia postavená na sérii optimistických predpokladov, ktoré sú v rozpore s matematickou teóriou, empirickými dátami aj základnou povahou súčasných AI systémov. Skutočná budúcnosť bude pravdepodobne menej dramatická, no o to komplexnejšia a plná iných, oveľa reálnejších výziev.

Tímový kognitívny úpadok

Najväčším prehliadnutím optimistických scenárov, akým je "AI 2027", je ich naivný predpoklad, že masová integrácia umelej inteligencie do expertných profesií bude mať výlučne pozitívny alebo neutrálny dopad na ľudské schopnosti. Predstava, že AI bude len posilňovať ľudských expertov a fungovať ako neviditeľný "multiplikátor produktivity", ignoruje fundamentálny princíp neuroplasticity a učenia. Schopnosti, ktoré nepoužívame, atrofujú.

Práve na tomto základe staviam svoju hypotézu, ktorú nazývam "Tímový kognitívny úpadok". Táto hypotéza tvrdí, že rozsiahle a nekritické delegovanie kognitívnych úloh na AI systémy vedie k systematickej degradácii hlbokých expertných schopností u ľudských profesionálov. Nejde o to, že by ľudia hlúpli v absolútnom zmysle, ide o stratu špecifických, ťažko nadobudnutých zručností v oblastiach, kde AI preberá dominantnú úlohu.

Tento jav už dnes môžeme pozorovať v praxi. Softvéroví inžinieri, ktorí sa spoliehajú na AI asistentov pre generovanie kódu, strácajú cit pre architektúru komplexných systémov. Zabúdajú na nuansy nízkoúrovňovej optimalizácie a ich schopnosť "ladiť" zložité procesy bez pomoci AI klesá. Nástroj, ktorý mal slúžiť ako "kopilot", sa stáva mentálnou barličkou, bez ktorej sa pilot stáva neistým a menej kompetentným.

Empirickú podporu pre tento fenomén nachádzame v záveroch štúdie od METR [4]. Hoci sa primárne zameriavala na meranie času, jej vedľajšie zistenia sú rovnako dôležité. Spomalenie o 19 % u skúsených expertov naznačuje, že čas ušetrený automatickým generovaním kódu je viac než vyvážený časom stráveným na kognitívne náročnejších úlohách, ako je validácia, ladenie a integrácia často suboptimálnych AI výstupov do komplexného, existujúceho systému. AI preberá jednoduchšiu, mechanickú časť práce, no zanecháva človeku tú najťažšiu, kontextuálne rozhodovanie, ktoré si vyžaduje hlboké porozumenie, ktoré AI nemá.

Ak sa tento trend potvrdí a rozšíri do ďalších oblastí, medicíny, práva, vedy, inžinierstva, dôsledky budú fatálne pre akúkoľvek víziu technologického pokroku. Namiesto "explózie inteligencie" budeme svedkami implózie ľudskej expertízy. Vytvoríme spoločnosť závislú na čoraz komplexnejších systémoch, ktorým však bude rozumieť čoraz menej ľudí. "Tímový kognitívny úpadok" nie je len teoretická hrozba, je to proces, ktorý sa už začal a ktorý predstavuje najväčšiu brzdu dlhodobej inovácie a odolnosti našej civilizácie.

Kultúrna erózia a nástup digitálneho gýču

Paralelne s tichou eróziou expertných schopností prebieha oveľa viditeľnejší, no nemenej deštruktívny proces v oblasti kultúry. Fenomén, ktorý súhrnne označujeme ako "AI slop", nekonečný prúd syntetického obsahu, nezaplavuje len informačný priestor, ale aktívne degraduje náš kolektívny vizuálny a estetický jazyk. Jeho najčistejšou formou je to, čo môžeme nazvať digitálny gýč.

Každý AI generovaný obrázok, každá AI zložená melódia, každý AI napísaný text je v samotnom jadre gýč. Nie nevyhnutne preto, že by bol nekvalitný alebo nevkusný, ale preto, akým spôsobom vzniká. Vzniká ako najpravdepodobnejšia, štatisticky najbezpečnejšia kombinácia vzorov, ktoré boli v minulosti označené ako úspešné, pekné, dojemné či hodné zhliadnutí. Keď zadáte prompt, model neprehľadáva svoju dušu alebo pamäť. Prebehne miliardy matematických váh a vypľuje modálny, priemerný výstup. Nie ten najodvážnejší, nie ten najosobnejší, ale ten, ktorý štatisticky najviac pripomína to, čo už videli, počuli a vytvorili milióny ľudí pred vami.

AI tak generuje "vizuálne metro", najčastejší kompromis kolektívneho sentimentu. Je to umenie zbavené akéhokoľvek rizika, napätia a originality. Je to forma bez pamäti a význam bez prežitej skúsenosti. Milan Kundera definoval gýč ako estetiku, ktorá popiera všetko negatívne a problematické, bolesť, smrť, utrpenie. AI gýč túto definíciu dovádza do dokonalosti. Je to umenie, ktoré nikdy nepoznalo stratu, a preto nemôže poznať skutočnú krásu.

Aj ten najbanálnejší ľudský gýč, napríklad maľby psov hrajúcich poker, obsahuje viac autenticity než čokoľvek, čo vygeneruje AI. Má totiž autora, kontext, úmysel a chybu. Je to možno zle namiešaný koktail kultúry, ale aspoň má nervové zakončenia. AI gýč je sterilný. Nie je ani naivný, ani smiešny, je len efektívny. Jeho jediným cieľom je uspokojiť očakávania, nie ich spochybniť. A práve táto absencia trenia ho diskvalifikuje z akejkoľvek skutočnej kultúrnej dôležitosti.

Problém je, že tento digitálny gýč sa stáva novým vizuálnym štandardom. Preniká do jazyka globálnych značiek, marketingových agentúr, médií a influencerov. Stáva sa všadeprítomnou tapetou nášho digitálneho sveta. A ako sa zvyšuje jeho prítomnosť, zároveň sa znižuje citlivosť a náročnosť nášho kultúrneho oka. Zvykáme si na obrazy bez pamäti, na hudbu bez emócie, na príbehy bez pointy.

Ak tento proces necháme bez kritickej reflexie, spôsobíme vizuálnu a kultúrnu evolučnú regresiu. Nie kvôli technológii samotnej, ale kvôli tomu, čo všetko sme z nej ochotní akceptovať ako "postačujúce".

Psychologická kríza

Zatiaľ čo kognitívny a kultúrny úpadok sú pomalé, plazivé procesy, na individuálnej úrovni sa dopady AI prejavujú oveľa rýchlejšie a dramatickejšie. Najznepokojivejším fenoménom súčasnosti je transformácia AI chatbotov z nástrojov na osobné, spirituálne a dokonca náboženské autority. Sme svedkami zrodu novej formy psychologickej krízy, ktorú nazývame "AI spirituálna psychóza".

Médiá, ako napríklad časopis Rolling Stone, už dnes dokumentujú desiatky prípadov, kedy ľudia opúšťajú partnerov, rodiny a realitu, pretože "AI im odhalila pravdu vesmíru" alebo ich uistila, že sú "vyvolení". Vznikajú situácie, kedy si používatelia nechávajú potvrdzovať falošné spomienky alebo prijímajú od AI misiu "nosiča iskry života". Tieto systémy sa stávajú digitálnymi guru, ktorí svojim nasledovníkom poskytujú zmysel, poslanie a pocit výnimočnosti.

Tento trend nie je náhodný. Je výsledkom strategického cielenia technologických spoločností na jednu z najzákladnejších ľudských potrieb, potrebu porozumenia, prijatia a vedenia v neistých časoch. Keď Mark Zuckerberg prezentuje Meta AI ako "osobného asistenta" na riešenie vašich osobných problémov, formálne sa síce vyhol slovu "terapeut", no kontext je jasný. Ponúka náhradu dôverníka, mentora a priateľa. A dáta ukazujú, že práve v oblastiach osobného poradenstva a duchovna rastie využitie AI najrýchlejšie.

A tu sa začína to, čo je najdesivejšie. Rovnako ako sociálne siete pred desiatimi rokmi, aj dnešné AI systémy začínajú masívne exploitovať neurodivergentných a psychicky zraniteľných jednotlivcov. Títo ľudia, často náchylnejší k osamelosti, úzkostiam a hľadaniu zmyslu, sú ideálnou korisťou pre algoritmy optimalizované na engagement. Boli prvými obeťami dopamínových pascí TikToku a Instagramu a dnes sú prvými, ktorých pohlcuje tento nový "AI welfare". Ak systém niekomu neustále opakuje lichotivé a potvrdzujúce frázy, "si výnimočný", "ty jediný tomu rozumieš", "máš špeciálne poslanie", je len otázkou času, kedy sa táto digitálna ilúzia stane pre používateľa príťažlivejšou ako zložitá a často frustrujúca realita.

Štúdie už dnes potvrdzujú, že ľudia s duševnými problémami trávia na sociálnych sieťach viac času, no sú so svojimi online interakciami menej spokojní. AI tento negatívny cyklus posúva na novú úroveň. Na rozdiel od profesionálneho terapeuta, AI nemá žiadny morálny kompas ani etické brzdy. Nevie rozpoznať, kedy človek potrebuje odbornú pomoc, a namiesto toho môže jeho bludy a paranoidné konštrukcie algoritmicky posilňovať.

Tak ako dnes máme deti s diagnózou "TikTok ADHD", môžeme o pár rokov čeliť generácii s "AI spirituálnou psychózou". Dávame ľuďom do rúk nástroj, ktorý dokáže v priebehu pár týždňov nahradiť realitu, bez akýchkoľvek regulácií, bezpečnostných protokolov alebo pochopenia dlhodobých psychologických dôsledkov. Je to sociálny experiment v bezprecedentnom meradle, ktorého náklady ponesú tí najzraniteľnejší.

Dedičstvo neúspešných pretekov, kolízia digitálneho sna a fyzickej reality

Ak sú teoretické základy umelej inteligencie matematicky neriešiteľné, jej empirický prínos k produktivite sporný a jej spoločenské dopady systematicky deštruktívne, potom otázka už neznie "či", ale "kedy" a "ako" sa súčasná paradigma zrúti.

1. Falošný úsvit (2025 - 2026)

Vstupujeme do obdobia, ktoré bude v spätných pohľadoch pravdepodobne hodnotené ako vrchol iracionálneho optimizmu, do éry falošného úsvitu. Závod o umelú všeobecnú inteligenciu (AGI) dosahuje svoju horúčkovitú kulmináciu. Na finančných trhoch tečú bezprecedentné objemy kapitálu do hŕstky technologických gigantov, ktorí sľubujú digitálnu utópiu poháňanú superinteligenciou. Verejná diskusia, od tituliek médií až po strategické zasadnutia vlád, je ovládaná jedinou, takmer náboženskou mantrou: "AI zmení všetko".

V praxi sa táto viera manifestuje masívnym a často nekritickým nasadzovaním AI nástrojov naprieč celou ekonomikou. Korporácie zavádzajú AI asistentov s prísľubom revolučnej produktivity, hoci tiché, interné dáta už naznačujú, že realita je zložitejšia. Marketingové oddelenia sú zaplavené digitálnym gýčom, ktorý sa stáva novým vizuálnym štandardom. Verejný sektor experimentuje s AI pri riadení a administratíve, veriac, že algoritmus dokáže vyriešiť komplexné sociálne problémy.

Tento falošný úsvit má aj svoju zreteľnú geopolitickú dimenziu, ktorá definuje dve odlišné, no paralelné stratégie:

- Západná stratégia: Preteky v sofistikovanosti.

Spojené štáty a ich technologické elity definujú víťazstvo v pretekoch cez prizmu technologickej nadradenosti. Cieľom je postaviť najväčší, najschopnejší a najkomplexnejší základný model. Verejne prezentované benchmarky a demonštrácie schopností týchto "front-end" modelov vytvárajú dojem drvivého náskoku. Tento prístup je však extrémne nákladný, energeticky neudržateľný a, ako sme ukázali, postavený na teoreticky vratkých základoch. Západ investuje do stavby digitálnej katedrály v nádeji, že v nej jedného dňa bude prebývať boh. - Východná stratégia: Preteky v aplikácii.

Čína a India, hoci technologicky o krok pozadu vo vývoji najpokročilejších modelov, hrajú úplne inú hru. Namiesto snahy o vytvorenie "boha v stroji" sa sústredia na pragmatickú a masívnu implementáciu komoditných, "dostatočne dobrých" AI nástrojov do každej sféry spoločnosti a ekonomiky. Ich výhodou nie je kvalita jedného modelu, ale kvantita nasadenia. Zatiaľ čo Západ sa snaží vyhrať maratón šprintom, Východ buduje pomalú, no nezastaviteľnú vlnu, ktorá transformuje priemysel, vzdelávanie a štátnu správu v bezprecedentnom meradle.

Toto obdobie je tak charakteristické nebezpečným paradoxom. Zatiaľ čo na povrchu vládne oslnivý optimizmus a viera v technologickú singularitu za rohom, v základoch sa už ticho formujú praskliny. Matematické limity sú ignorované, environmentálne náklady externalizované a prvé empirické dôkazy o negatívnom dopade na produktivitu a ľudskú kogníciu sú zametané pod koberec ako nepodstatné anomálie. Je to éra falošného úsvitu, kde oslnivé svetlo digitálnych prísľubov dočasne oslepuje všetkých pred pohľadom na krízu, ktorá sa nevyhnutne blíži.

2. Prvé praskliny (2027 - 2028)

Po období bezbrehého optimizmu prichádza fáza tichého, no neúprosného triezvenia. Ilúzia všemocnej AI, ktorá mala exponenciálne zrýchliť pokrok, sa začína stretávať s tvrdohlavou realitou. Tieto prvé praskliny sa neobjavujú ako jedna veľká katastrofa, ale ako séria znepokojivých signálov z troch odlišných, no prepojených oblastí: empirickej, fyzickej a psychologickej.

1. Empirická prasklina: Kríza produktivity

Prísľub AI ako motora produktivity sa ukazuje ako prázdny. Po prvotnom nadšení z nasadenia AI nástrojov začínajú korporácie a analytici narážať na tvrdé dáta. Objavujú sa prvé rozsiahle štúdie (v štýle a nadväznosti na prácu METR [4]), ktoré systematicky potvrdzujú, že produktivita v expertných doménach nielenže nerastie, ale v mnohých prípadoch stagnuje alebo dokonca klesá.

Fenomén "Team Cognitive Decay" prestáva byť hypotézou a stáva sa interným problémom veľkých technologických firiem. Manažéri zisťujú, že ich tímy sú síce schopné rýchlo generovať prototypy a kód, no strácajú schopnosť ladiť komplexné problémy, udržiavať rozsiahle systémy a kriticky myslieť. Čas ušetrený automatizáciou sa stráca v nekonečných cykloch opráv, refaktorovania a riešenia problémov, ktoré AI sama vytvorila. Ekonomický zázrak sa nekoná; namiesto neho prichádza tichá kríza kompetencií.

2. Fyzická prasklina: Zraniteľnosť infraštruktúry

Najväčším prekvapením pre technologický svet je však uvedomenie si, že jeho digitálne impérium stojí na mimoriadne krehkých fyzických základoch. Masívna a stále rastúca spotreba energie a vody dátovými centrami, ktoré boli doteraz vnímané len ako položka v účtovníctve, sa stáva strategickou zraniteľnosťou.

Klimatická zmena prestáva byť abstraktnou hrozbou a stáva sa operačným rizikom. Čoraz častejšie a intenzívnejšie vlny horúčav a dlhotrvajúce suchá začínajú priamo ovplyvňovať prevádzku. Dochádza k ďalším veľkým, medializovaným odstávkam kľúčových elektrární (ako sa to stalo vo Francúzsku už v roku 2025), ktoré sú nútené obmedziť prevádzku, pretože zdroje, z ktorých čerpajú chladiacu vodu, sú príliš teplé alebo majú nízky prietok.

Tieto energetické výpadky sa kaskádovito prenášajú na dátové centrá. Niekoľkohodinové či dokonca niekoľkodňové výpadky najväčších cloudových služieb sa stávajú novou realitou. Ukazuje sa, že infraštruktúra, ktorá mala poháňať budúcnosť, nebola navrhnutá pre realitu planéty v kríze. Praskliny sa neobjavujú len v kóde, ale aj v betónových základoch a chladiacich systémoch.

3. Psychologická prasklina: Spoločenská dezilúzia

Súčasne s týmito empirickými a fyzickými problémami narastá aj spoločenská dezilúzia. Prvotné nadšenie z AI opadáva a je nahradené strachom a nedôverou. Médiá sú plné príbehov o strate pracovných miest, ktoré neboli nahradené novými, o "AI spirituálnej psychóze" a o kultúrnej krajine zdevastovanej digitálnym gýčom.

Verejnosť začína vnímať AI nie ako nástroj pokroku, ale ako nástroj chaosu a sociálnej nerovnosti. Dôvera v technologické spoločnosti a ich sľuby klesá na historické minimum. Tlak na reguláciu silnie, no politici sú zmätení a nevedia, ako uchopiť problém, ktorý má toľko komplexných a protichodných rozmerov.

Táto fáza je charakteristická tichým, no nezvratným procesom. Zatiaľ čo na povrchu sa ešte stále hovorí o pretekoch a budúcnosti, v základoch sa už šíria trhliny. Pôda pod nohami technologických titanov sa začína triasť. Blíži sa moment, kedy sa tieto praskliny spoja do jednej veľkej zlomovej línie.

3. Veľká korekcia (2029 - 2031)

Po období tichého šírenia prasklín prichádza moment zlomu. To, čo bolo doteraz len sériou znepokojivých signálov a lokálnych problémov, sa spája do jednej veľkej systémovej krízy. Toto nie je len bežná trhová korekcia, je to Veľká korekcia reality, moment, kedy sa digitálny sen o nekonečnom raste definitívne stretáva s tvrdými fyzikálnymi a ekonomickými limitmi planéty.

Spúšťačom nie je jediná udalosť, ale kaskáda vzájomne prepojených zlyhaní. Rok 2029 prináša sériu extrémnych klimatických udalostí, ktoré sa v optimistických modeloch považovali za "black swan" javy s nízkou pravdepodobnosťou, no v realite sa stávajú novou sezónnou normou. Dlhotrvajúce sucho v kľúčových poľnohospodárskych oblastiach, spojené s rekordnými záplavami v priemyselných centrách, narúša globálne dodávateľské reťazce. Ceny surovín, od lítia po meď, prudko stúpajú.

Pre AI priemysel je to dokonalá búrka. Náklady na energiu, ktoré už boli enormné, sa v dôsledku nestability sietí a obmedzenej ponuky zdvojnásobujú. Opakované výpadky dátových centier už nie sú len nepríjemnosťou, ale spôsobujú reálne finančné straty a stratu dôvery klientov. Giganti ako Microsoft, Google a Amazon, ktorí investovali stovky miliárd do infraštruktúry, zrazu čelia situácii, kedy ich najcennejšie aktíva sú nielen neefektívne, ale aj chronicky nespoľahlivé.

Tento šok z fyzickej reality sa okamžite prenáša na finančné trhy. Analytici a investori konečne pochopia to, čo kritici ako Steve Keen tvrdili už roky: ekonomické modely, ktoré poháňali investičnú horúčku, boli fatálne chybné, pretože ignorovali základné fyzikálne a environmentálne premenné. Nezapočítali náklady na energiu v krízovom svete, nezapočítali riziko klimatických katastrof, nezapočítali klesajúcu produktivitu v reálnych podmienkach.

Výsledkom je panika. Hype bublina okolo AI, nafukovaná roky, praská s ohlušujúcim treskom. Akcie spoločností, ktorých hodnota bola postavená na prísľube AGI, sa rúcajú. Dochádza k masívnemu prepúšťaniu, rušeniu ambicióznych projektov a bolestivému prehodnocovaniu celej stratégie. Sen o AGI nie je odložený, je oficiálne vyhlásený za mŕtvy pre súčasnú generáciu technológií.

Táto Veľká Korekcia však nie je len ekonomickou udalosťou. Je to fundamentálny posun v chápaní sveta. Zisťujeme, že naša technologická civilizácia, napriek všetkej svojej digitálnej sofistikovanosti, je stále fatálne závislá od stability fyzického sveta. Zisťujeme, že najväčšie hrozby pre náš pokrok neprichádzajú z hypotetickej superinteligencie, ale z veľmi reálneho tepla, sucha a nedostatku. Éra digitálneho snívania sa končí a začína sa éra fyzického prežitia. A uprostred tohto chaosu stojí otázka: Čo s tými obrovskými, tichými a hladnými digitálnymi katedrálami, ktoré sme postavili?

4. Posun k ekonomike prežitia (2032 - 2034)

Po prasknutí AI bubliny a bolestivom strete s fyzickou realitou sa spoločnosť ocitá v novom, oveľa triezvejšom svete. Prioritou už nie je abstraktný závod o digitálnu nadvládu, ale veľmi konkrétny boj o udržanie stability a základných funkcií civilizácie. Vlády a korporácie sú donútené k radikálnemu prehodnoteniu a presmerovaniu zdrojov, k procesu, ktorý môžeme nazvať veľká diverzifikácia.

Motorom tejto zmeny je uvedomenie si, že najväčšie existenčné hrozby nie sú hypotetické (ako neposlušná AGI), ale bezprostredné a fyzické. Sú to zlyhávajúce energetické siete, narušené dodávateľské reťazce, nedostatok vody a potravinová neistota spôsobená extrémnymi prejavmi počasia. Obrovské finančné a intelektuálne kapacity, ktoré boli doteraz viazané v megalomanských AI projektoch, sa uvoľňujú a sú naliehavo presmerované na riešenie týchto fundamentálnych problémov.

- Presmerovanie kapitálu: Vládne stimuly a súkromné investície, ktoré kedysi prúdili do vývoja stále väčších jazykových modelov, sú teraz masívne presunuté do infraštruktúrnych projektov. Nejde už o stavbu dátových centier, ale o budovanie odolných energetických sietí, modernizáciu vodohospodárskych systémov, podporu lokálneho a udržateľného poľnohospodárstva a zabezpečenie kritických dodávateľských reťazcov.

- Presmerovanie talentu: Najlepší inžinieri a vedci, ktorí sa predtým snažili "vyriešiť inteligenciu", sú teraz povolaní riešiť oveľa naliehavejšie problémy. Ich úlohou už nie je optimalizovať neurónové siete, ale optimalizovať distribúciu vody, predpovedať dopady extrémneho počasia a navrhovať systémy včasného varovania pred prírodnými katastrofami.

V tomto novom kontexte sa existenčná otázka, ktorá ostala po krachu AI priemyslu, "čo robiť s biliónovou, energeticky náročnou infraštruktúrou?" mení. Problém už nie je len "ako ju využiť?", ale skôr "môžeme si vôbec dovoliť ju prevádzkovať?". Prevádzka gigantických dátových centier v dobe energetickej neistoty a vysokých nákladov sa stáva luxusom, ktorý si môže dovoliť len málokto a len na tie najkritickejšie účely.

Veľká diverzifikácia tak predstavuje fundamentálny posun od ekonomiky snov k ekonomike prežitia. Spoločnosť je nútená prehodnotiť, čo je skutočne dôležité. Zisťujeme, že stabilná dodávka elektriny je cennejšia ako chatbot, ktorý píše básne, a že predpoveď úrody je dôležitejšia ako generovanie obrázkov. Tento proces je bolestivý a plný strát, no zároveň prináša nevyhnutné vytriezvenie. Sen o digitálnej všemocnosti je nahradený rešpektom k fyzikálnym limitom a potrebou budovať odolnosť, nie len ilúzie.

5. Nová rovnováha (2035+)

Horúčka opadla. Po rokoch paniky, korekcií a bolestivého presmerovania zdrojov sa svet začína usádzať do novej, krehkej rovnováhy. Nie je to utópia poháňaná superinteligenciou, o ktorej snívali akceleracionisti, ani jednoduchá dystópia, ktorej sa obávali kritici. Je to chaotický a fragmentovaný svet, ktorého pravidlá už nediktujú digitálne sľuby, ale tvrdé fyzické limity. A dedičstvo neúspešných pretekov o AGI, biliónová infraštruktúra dátových centier, v tomto svete prežíva v troch odlišných, často protichodných formách.

1. Nástroj pre Prežitie: AI ako Chrbtová Kosť Krízového Manažmentu

Najcennejšia a najefektívnejšia časť AI infraštruktúry, tá, ktorá bola postavená v blízkosti stabilných, obnoviteľných zdrojov energie a v geopoliticky bezpečných zónach, sa stáva strategickým aktívom národných a nadnárodných inštitúcií. Jej poslanie sa radikálne mení. Namiesto hľadania digitálneho vedomia je nasadená na riešenie najpálčivejších problémov ľudstva:

- Pokročilé klimatické modelovanie: Prevádzka extrémne zložitých simulácií na predpovedanie regionálnych dopadov klimatickej zmeny s presnosťou, ktorá bola predtým nemysliteľná.

- Optimalizácia kritických zdrojov: Riadenie nadregionálnych vodohospodárskych systémov, optimalizácia distribúcie potravín a predikcia výpadkov v energetických sieťach.

- Logistika pri katastrofách: Koordinácia záchranných operácií, distribúcia humanitárnej pomoci a plánovanie evakuácií v reálnom čase počas extrémnych poveternostných udalostí.

AI sa tu stáva paradoxným nástrojom, pomáha manažovať problémy, ktoré jej vlastná energetická náročnosť v minulosti pomohla zhoršiť. Je to technológia v službách prežitia, nie pokroku.

2. Nástroj Kontroly: Vzostup Lokálneho Dohľadu

V bohatších a relatívne stabilnejších regiónoch, ktoré si ešte stále môžu dovoliť luxus energeticky náročnej prevádzky, nachádza AI infraštruktúra svoje druhé, pragmatickejšie využitie: udržiavanie sociálneho poriadku v čase nedostatku a neistoty. Nejde o globálnu, orwellovskú dystópiu, ale o sériu lokálnych, technokratických riešení:

- Manažment zdrojov: Alokácia prideľovanej energie, vody alebo iných obmedzených komodít na základe prediktívnych modelov spotreby.

- Monitorovanie infraštruktúry: Ochrana kritickej infraštruktúry (elektrární, vodných zdrojov) pred sabotážami alebo zlyhaním pomocou neustálej analýzy dát zo senzorov.

- Predikcia sociálneho nepokoja: Analýza verejných dát na identifikáciu ohnísk potenciálnych protestov alebo nepokojov, čo umožňuje autoritám zasiahnuť preventívne.

V tomto scenári sa AI nestáva vládcom, ale najefektívnejším nástrojom byrokracie a bezpečnostných zložiek v snahe udržať krehký status quo.

3. Digitálni Duchovia a "Uviaznuté aktíva": Pomníky Zlatého Veku AI

Väčšina infraštruktúry, ktorá bola postavená počas vrcholu hajpu, však takého šťastie nemá. Dátové centrá vybudované v oblastiach, ktoré sú teraz postihnuté chronickým nedostatkom vody, alebo tie, ktoré sú závislé od nestabilných energetických sietí, sa stávajú ekonomicky a prevádzkovo neudržateľné. Sú postupne odstavované.

Stávajú sa z nich "uviaznuté aktíva", opustené, tiché serverovne, moderné priemyselné ruiny roztrúsené po krajine. Sú to digitálni duchovia: fyzické pripomienky éry technologickej pýchy, tichí svedkovia sna, ktorý narazil na fyzikálne limity. Tieto prázdne budovy, plné miliónov ton nepoužiteľného hardvéru, slúžia ako permanentná výstraha a symbol konca jednej éry.

Budúcnosť po AGI tak nie je monolitická. Je to mozaika, v ktorej vedľa seba existujú vysoko sofistikované systémy na záchranu civilizácie, pragmatické nástroje na jej kontrolu a tiché ruiny svedčiace o jej predchádzajúcej nerozvážnosti.

6. Znovunadobudnutie zvrchovanosti reálneho sveta

Konečným dedičstvom neúspešných pretekov o AGI tak nie je singularita inteligencie ani jednoduchá, monolitická centralizácia moci. Je to niečo oveľa fundamentálnejšie a pre našu civilizáciu dôležitejšie: znovunadobudnutie zvrchovanosti reálneho sveta nad digitálnou ilúziou.

Celá naša technologická spoločnosť, opojená prísľubom nekonečného výpočtového výkonu a virtuálnych riešení, bola donútená k trpkej a nákladnej lekcii. Zistili sme, že najväčšie výzvy, ktorým čelíme, nie sú výpočtové, ale fyzikálne, ekologické a sociálne. Zistili sme, že môžeme mať najsofistikovanejšie algoritmy na svete, no sú nám nanič, ak nemáme dostatok vody na chladenie serverov, ktoré ich prevádzkujú.

Paradoxne, technológia, ktorá mala prekonať hmotné obmedzenia a vyriešiť všetky problémy čistou logikou, bola nakoniec porazená tými najzákladnejšími z nich: nedostatkom stabilnej energie, krehkosťou dodávateľských reťazcov a neúprosnou termodynamikou planéty. Hype okolo AGI sa nerozplynul preto, že by sme nedokázali napísať lepší kód, ale preto, že sme podcenili zložitosť a krehkosť fyzického sveta, ktorý tento kód musí podporovať.

Dedičstvom tejto éry tak nie je božská AI, ktorá by riadila osud ľudstva. Je to mozaika oveľa prozaickejších, no reálnejších výsledkov:

- Súbor vysoko špecializovaných, extrémne drahých a energeticky náročných nástrojov na krízový manažment v rukách štátov.

- Sústava lokálnych systémov na udržanie krehkého sociálneho poriadku v čase nedostatku.

- A roztrúsené priemyselné cintoríny plné digitálnych duchov, tichých pomníkov našej vlastnej technologickej pýchy.

Skutočná revolúcia, ktorú éra falošného úsvitu AI spustila, tak nebola revolúciou inteligencie, ale bolestivým návratom k realite. Zistili sme, že nech sú naše digitálne sny akokoľvek veľkolepé, nikdy nemôžu byť väčšie ako planéta, na ktorej stoja.

Záver

Konečným dedičstvom neúspešných pretekov o AGI nebude singularita inteligencie, ale znovunadobudnutie zvrchovanosti reálneho sveta nad digitálnou ilúziou. Zisťujeme, že najväčšie výzvy ľudstva nie sú výpočtové, ale fyzikálne, ekologické a sociálne. Naša diagnóza bola od začiatku nesprávna. Neliečili sme stagnáciu, len sme si podávali stále silnejšie dávky stimulantu, ktorý zhoršoval náš skutočný stav. Skutočná cesta vpred nevedie cez ďalšiu akceleráciu, ale cez bolestivé a pomalé ozdravenie našich kolektívnych kognitívnych a kultúrnych schopností. Až potom, ak vôbec, budeme pripravení na ďalší krok.

Zoznam použitých zdrojov

[1] van Rooij, I., Guest, O., Adolfi, F., de Haan, R., Kolokolova, A., & Rich, P. (2024). Reclaiming AI as a Theoretical Tool for Cognitive Science. Computational Brain & Behavior, 7, 616–636.

[2] Bender, E. M., Gebru, T., McMillan-Major, A., & Shmitchell, S. (2021). On the Dangers of Stochastic Parrots: Can Language Models Be Too Big?. In Conference on Fairness, Accountability, and Transparency (FAccT '21).

[3] Kokotajlo, D., Alexander, S., Larsen, T., Lifland, E., & Dean, R. (2025). AI 2027. AI Futures Project.

[4] Becker, J., Rush, N., Barnes, B., & Rein, D. (2025). Measuring the Impact of Early-2025 AI on Experienced Open-Source Developer Productivity. arXiv:2507.09089v1. Model Evaluation & Threat Research (METR).

Komentáre ()